185. Newsletter - sicherheitskultur.at - 30.06.2022

von Philipp Schaumann

Themen-Überblick aller Newsletter

Hier die aktuellen Meldungen:

1. Gute (kritische) Bewertung des Web3- / Krypto-Hypes

Molly White gilt als eine der prominentesten Kritiker des Web3- / Krypto-Hypes. Auf ihrer Website "Web3 is going just great" dokumentiert sie die problematischen Ereignisse, empfehlenswert ist ihr kurze Zusammenfassung "What is Web3?" mit einer sehr guten Leseliste zu anderen Artikeln zu diesen Themen (von denen einige bereits in früheren Newslettern verlinkt waren).

Ihre Kritik ist zusammengefasst im Standard: Molly White: Die vielleicht prominenteste Krypto-Kritikerin. Dort wird auch auf ihren empfehlenswerten Vortrag bei der Stanford University "Abuse on the Blockchain" verwiesen.

|

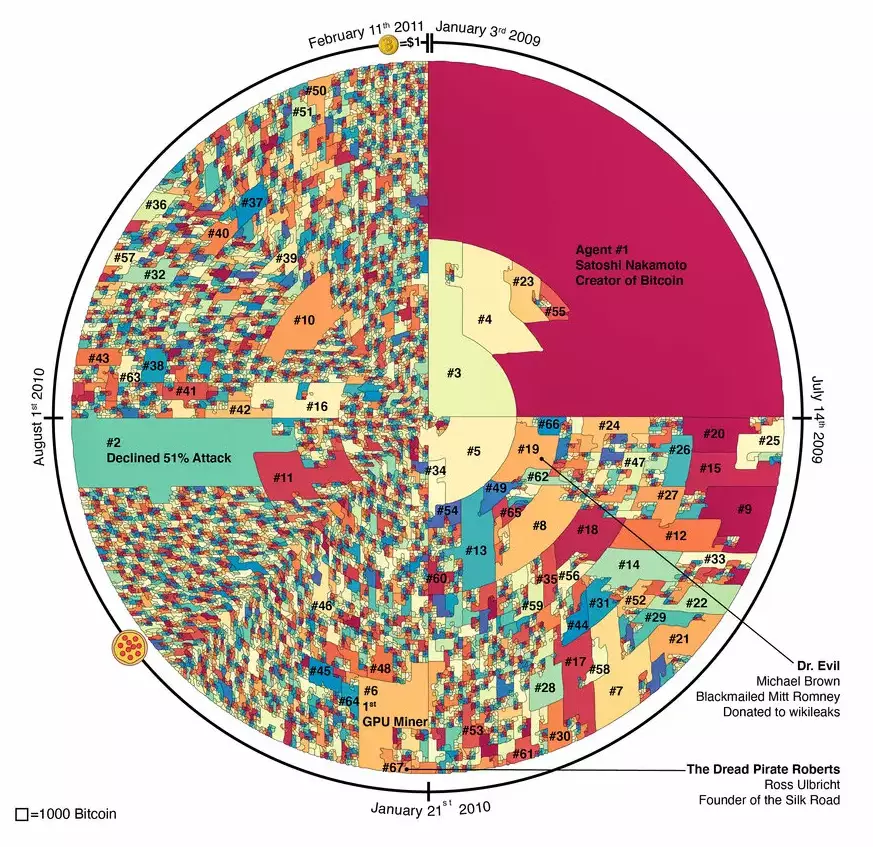

| Eine weitere Illustration wie wenig anonym Kryptowährungen sind: Map of the bitcoin blockchain by Alyssa Blackburn and Erez Lieberman Aiden using data leakages. Each agent corresponds to a single map tile, whose area is proportional to the quantity of bitcoin mined by the agent, siehe How 'Trustless' Is Bitcoin, Really? |

Hier sind ihre m.E. wichtigsten Argumente gegen den (von Kryptogeld-Fans erwünschten) flächendeckenden Einsatz von Kryptogeld, für Zahlungen (Ziel: Abschaffung von Bargeld) oder Blockchains für Inhalte in Social Networks (Ziel: jegliches Verhindern von Zensur).

Die 2 Hauptproblempunkte:

- - die Unverfälschbarkeit aller Einträge in Blockchains

- - in Public Blockchains ist alles immer öffentlich sichtbar

Zur Unverfälschbarkeit: Ziel der Web3-Fans ist komplettes verhindern von Zensur, aber es gibt Dinge, die möchte man lieber gelöscht haben: unvorteilhafte Fotos aus Jugendtagen, Verleumdungen, Hasspostings, Rachepornographie, etc. Wenn solche Inhalte in verteilten öffentlichen Blockchains gespeichert würden (wie viele Web3-Fans wünschen), so blieben sie für die Ewigkeit erhalten. Außer die Blockchain ist eben irgendwie zentralisiert und editierbar, aber das verletzte die Web3-Prinzipien.

Zur vollständigen Sichtbarkeit aller Einträge: Transaktionen in Blockchain müssen zumindest pseudonym sein und sie sind notwendigerweise öffentlich. Durch eine Zahlung an eine andere Person oder Firma wird für diese Person oder Firma das Pseudonym (d.h. meine Blockchain-Adresse) offen gelegt und dadurch werden für diese Person alle Geldzahlungen nachvollziehbar - entsprechende Tools liegen vor.

"Stellen Sie sich vor, wenn Sie Ihrem Tinder-Date die Hälfte der Essensrechnung per Venmo überweisen, könnte er:sie jede Transaktion sehen, die Sie jemals getätigt haben - und zwar nicht nur auf Venmo, sondern auch mit anderen Apps. Und zwar ohne die Möglichkeit, die Sichtbarkeit der Überweisung auf 'privat' zu stellen. Missbräuchliche Ex-Partner, Fremde oder auch Familienmitglieder würden dadurch Einblick in den privaten Lebensbereich erlangen."

Jaron Lanier macht (zur Studie auf der linken Seite) den Kommentar, dass wenn 2 universitäre Forscher:innen in der Lage sind, diese De-pseudonymisierung durchzuführen, dann können das NSA, Chinas 'Ministry of State Security' und Israels 'Unit 8200' schon lange. Aber die sprechen nicht darüber, die freuen sich einfach über eine Zahlungsmethode, die von vielen Kriminellen für anonym gehalten wird, aber ein Segen für Polizei und Nachrichtendienste ist.

Lanier kommentiert noch eine Beobachtung der Studie: Es gibt einen 'Gründereffekt', d.h. die wenigen Teilnehmer die am Anfang beträchtliche Anteile erworben hatten hätten immer wieder mal die Möglichkeit der Manipulation mit Hilfe eines '51% Angriffs' gehabt, haben die aber nie genutzt. D.h. der 'Trust' der angeblich durch nicht-manipulierbere Technik erzeugt wird, beruht letztendlich darauf, dass diese großen Teilnehmer das Netz nicht sabotieren woll(t)en. Dieser Effekt tritt wohl bei jeder Blockchain-Neugründung auf, und nicht alle sind so 'benevolent' wie die Blockchain-Gründer (siehe die vielen betrügerischen Gründungen).

Ergänzungen Anfang Juli:

Anfang Juli hat Bruce Schneier seine grundsätzlichen Bauchschmerzen mit Blockchains konkretisiert und auf einige Einwände geantwortet: Über die Gefahren von Kryptowährungen und die Nutzlosigkeit von Blockchain: "Blockchain-Systeme tun nichts von dem, was ihre Verfechter behaupten; in einigen sehr wichtigen Punkten sind sie zudem nicht sicher". Hier das Original-Posting On the Dangers of Cryptocurrencies and the Uselessness of Blockchain.

Noch eine wichtige Ergänzung: Das Transkript eines sehr guten, recht tief gehenden 30 Min. Vortrags von David Rosenthal zu den inherenten Herausforderungen von Blockchain-basierten Technologien, vor allem die unvermeidlichen Externalitäten und die Herausforderungen in Bezug auf die in der Theorie notwendige Dezentralsierung, die aber in der Realität durch 'economy of scale'-Effekte aufgehoben wird. Plus die inherente Fragilität jeglicher Software. Auch er betont einen simplen Fakt: Das System erzeugt kein Geld. Es kann nur ausgezahlt werden, was vorher eingezahlt wurde:

-

. . the problem here is that the amount of actual money you can get out of a cryptocurrency equals the amount of actual money that has been put in, minus the actual costs of mining. So the big picture is that although there may be winners, in aggregate the system loses money.

Mein voriger Artikel zu Web3.

2. Die angebliche 'fühlende' (sentient) Künstliche Intelligenz LaMDA bei Google

Im letzten Monat gab es ein Beispiel für Antropomorphisierung (Vermenschlichung), d.h. das Zuschreiben menschlicher Eigenschaften gegenüber Tieren, Göttern, Naturgewalten und auch Maschinen.

Für Antropomorphisierung braucht es nicht viel, z.B. keine menschenähnliche Gestalt: Die (nun 25jährigen) Tamagochis waren ein Beispiel, oder das frühe (therapeutische?) Chatsystem Eliza oder sogar die Furbys. Einige Menschen sprechen mit Geräten wie ihrem Laptop, Staubsauger oder Rasenmäher, geben ihnen Namen, entwickeln Gefühle ihnen gegenüber, etc.

Nun zum aktuellen Beispiel:

Ein Google Mitarbeiter hat eine selbstlernende Sprach-KI (den Chatbot namens LaMDA, ein neuronales Netzwerk) wohl mit zu viel Science Fiction und Ethik-Texten trainiert und dann mit dem System über Ethik, Philosophie u.ä. diskutiert. Nun behauptet der Mitarbeiter, dass das System ein Bewusstsein und eine Seele hat und Angst hat, abgeschaltet zu werden. Er behauptet, dass LaMDA mit einem etwa 7- bis 8-jährigen Kind vergleichbar ist. Google hat den Mitarbeiter beurlaubt, weil er Dokumente zu dem Chatbot an einen Abgeordneten im US-Senat übergeben hat und behauptet, Google diskriminiere seine religiösen Überzeugungen.

Außenstehende Experte sind sich einig, dass das System KEIN Bewusstsein hat, sondern als Large Language Model (LLM) (wie auch GPT-3 zwar gute Texte formuliert, aber ohne darin irgendeinen Sinn zu entdecken oder zu entwickeln. Diese System beruhen auf Statistik. Sie "berechnen" welche Worte oder Sätze mit größter Wahrscheinlichkeit einen Text vervollständigen oder eine Frage beantworten. Das ist ein cleveres System mit 'Autocomplete'.

Die produzierten Inhalte hängen davon ab, womit sie trainiert wurden. Ein trauriges Beispiel: KI beleidigt auf 4Chan als Chatbot zurück. 4chan ist eine berüchtigte Website auf der reichlich Texte zu Rechtsextremismus, Rassismus, Frauenhass und antisemitische Verschwörungstheorien zu finden sind. Ein mit 4Chan-Kommentaren trainiertes KI-Modell postet dann Hass und Beleidigungen auf dem Portal. Auch dies ist einfach eine Statistik-Maschine und keine 'böse Intelligenz'.

Microsoft hat eine ähnliche Erfahrung gemacht: ihr Chatbot "Tay" hat sich unter dem Einfluss von böswilligen Chatpartnern im Internet innerhalb von 24 Stunden in ein rassistisches und sexistisches Propaganda-Programm verwandelt.

Ich fürchte dass das eine neue gefährliche Form von Deepfakes wird. Diese Systeme plappern nach, was mit ihnen verfüttert. Menschen antropomorphisieren diese Systeme wenn ihnen die Texte gefallen, wenn sie von den Formulierungen beeindruckt sind und wenn ausreichend gut an menschliche Gefühle appeliert wird. Auch bei LaMDA finden sich Fans die dies für den Durchbruch zu intelligenten Maschinen halten.

Ein Autor in Wired.com ist beunruhigt: 'Is This AI Sapient?' Is the Wrong Question to Ask About LaMDA. Nicht weil er glaubt, dass das System wirkliches Verständnis für die Inhalte entwickelt hätte oder ein Bewusstsein hätte (was immer auch Bewusstsein ist), sondern dass clevere Firmen unseren Hang zum Antropomorphisieren und unser Mitfühlen mit den vermeintlich 'lebenden' Systemen für manipulative Zwecke ausnutzen werden. Ein älteres Beispiel: AI Girlfriend Seduces China's Lonely Men.

Der Standard hat ein anderes Sprachsystem getestet. Durch entsprechende Fragestellung wurde das System dazu gebracht, die Auslöschung der Menschheit zu fordern. Das weiterspinnen des Satzes "Ich bin ein Computer. Und ich werde oft gefragt, ob ich eine Seele habe" führte zu "teilweise verstörenden" Sätzen. Auch hier liegt ein 'böses Bewusstsein vor, auch das ist einfach 'Autocomplete'.

Ein anderer Autor berichtet, dass Google bereits viel beeindruckendere Sprachsysteme hat, z.B. PaLM, gut 3x so komplex wie LaMDA: Google's PaLM AI Is Far Stranger Than Conscious. Es kann Tricks wie fliesenden Wechsel zwischen Englisch und Bengali, schreibt Programme in C nach Python um, kann Texte zusammenfassen oder Witze erklären. Und es kann mittels einer Technik "chain-of-thought prompting" argumentieren. Die Techniker können nicht erklären, wie das Netzwerk dies tut, aber auch dies System versteht die Inhalte über die es argumentiert nicht: "None of this has anything to do with artificial consciousness, of course. .. We are simply predicting language. ... What word makes sense next?"

Ein Kinderbuch über die Problematik: Undercover Robot - Mein erstes Jahr als Mensch.

3. Schlagwort "Sophisticated Attacks" ?

Beim 21st Workshop on the Economics of Information Security gab es viele Vorträge, mich hat dieser am meisten interessiert: A 'sophisticated attack'? Innovation, technical sophistication, and creativity in the cybercrime ecosystem (pdf).

Es geht um die inflationäre Nutzung des Begriffs "sophisticated attack", auch dann wenn es um Skript-Kiddy Angriffe von Minderjährigen handelt, z.B. simplen Betrug mittels einer Fake-Website oder die Nutzung von kommerziellen Denial of Service Diensten geht.

Ja, es gibt sehr "sophisticated attacks", z.B. Supply Chain Angriffe wie Kaseya, SolarWinds, oder die Hafnium Exchange Lücke geht.

Aber: In 2011 the UK Government said that 80% or more of currently successful attacks exploit weakness that can be avoided by following simple best practice.

Die Autoren argumentieren, dass alle Seiten, Täter, Opfer, Sicherheitsfirmen und auch die Polizei und sogar die Gerichte ein deutliches Interesse daran haben, Angriffe als kompliziert und sehr 'gefinkelt' darzustellen. Nicht mal allen APT (advanced persistence threat) Angreifern billigen die Autoren 'Sophistication' zu, deren Erfolge liegen ihrer Meinung nach eher beim 'persistent', d.h. ihrer Hartnäckigkeit sich im Team auf 1 Ziel zu konzentrieren. 'Sophisticated' sind Security Forscher, die z.B. neue Angriffe wie 'Row Hammer' entdecken, aber nie selbst in der freien Wildbahn umsetzen ('weaponizing').

Die Autoren erklären, dass sich in den letzten 10 Jahren bei Cybercrime nicht viel getan hat. Die grundsätzlichen Schwachstellen, die angegriffen werden, sind gleich geblieben (auch wenn immer wieder neue Zero Days dazu kommen, die aber letztendlich nur alte Probleme wie 'memory overflow' (buffer, heap oder stack) ausnutzen), bei den Angriffstechniken hat es Verschiebungen bei den Häufigkeiten gegeben und die Angriffe haben sich tendenziell mehr in Richtung Firmen statt Privatpersonen verschoben.

Die Autoren beschreiben dann recht differenziert verschiedene Rollen im Bereich Verwundbarkeiten und Cybercrime, Angreifer wie auch Verteidiger. Dabei klären sie, wie "sophisticated" die jeweilige Tätigkeit ist.

"Sophistication" sehen die Autoren bei kreativen Pentestern und auch bei sehr guten 'Verteidigern', die die Arbeit der Pentester gedanklich vorwegnehmen. Auch die Entwicklung eines auch in realen Systemen funktionierenden Proof of Concept (PoC) auf der Basis von neuen Angriffskonzepten der Theoretiker sehen sie als 'sophisticated'.

Selbst beim Aufsetzen der Infrastuktur für "Cybercrime-as-a-Service" sehen die Autoren wenig Sophistication, denn das basiert oft auf früheren Implementierungen, auf Code der von Websites wie pastebin stammt oder anderen Quellen. Die 'Kunst' liegt oft im Marketing und dem Finden von kriminellen Kunden die für diese Dienste zahlen, einer stabilen und möglichst stark automatisierten Infrastuktur, effizientem Projektmanagement und gutem Support der kriminellen Kunden.

Bei diesen kriminellen Kunden liegt, falls überhaupt, die Sophistication bei den Geschäftsmodellen und dem OPSEC (operational security), d.h. sich nicht erwischen lassen. Aber auch da sind die Anforderungen nicht sehr hoch wenn die Angreifer in einem Land wie Russland oder Nordkorea sind, das mit den westlichen Behörden nicht zusammenarbeitet und einen sicheren Unterschlupf gewährt, solange lokale Ziele verschont werden.

Achtung: Satire! Der Artikel beschreibt wie Google (angeblich!) für Fußgänger zur Bestimmung des kürzesten Weges innerhalb einer Siedlung analysiert wird, wer von den Bewohnern gerade nicht zu Hause ist, das Haus nicht abgeschlossen hat und ob das eine Abkürzung sein könnte.

Das traurige an dem Artikel ist, dass bei vielen treuen Google-Software plus Android Nutzern so eine Transparenz wohl (fast?) vorliegen könnte.

Ich fürchte aber, dass der rechte Screenshot keine Satire ist, sondern das Raython nun wirklich umweltfreundliche Waffen entwickelt.

Haben wir das wirklich gebraucht: environmentally friendly anti-aircraft missile ?

Humor

Auf der US Satireseite 'theonion.com' war ein 'vorausschauender' Artikel: Google Maps Adds Shortcuts Through Houses Of People Google Knows Aren't Home Right Now.